从芯片到模型,从龙虾到数据中心,GTC 2026 的潜台词只有一句话:一切都要为 Agent 让路。

开场:史上悬念最少的一届

2022 年说元宇宙,2023-2024 年说生成式 AI,2025 年说物理 AI。但 GTC 2026 不一样——即便黄仁勋还没开口,所有人已经知道答案了:Agent。

英伟达甚至在 GTC 园区里开了「Build-a-Claw」互动专区,让与会者现场搭建自己的 AI Agent。这个小细节说明了一切:Agent 不是未来,是现在。

Vera Rubin 架构:专为 Agent 时代打造的超级计算

如果说 Hopper 架构开启了生成式 AI 的时代,让机器学会了「说话」;那么 Vera Rubin 的使命,就是开启智能体时代,让机器学会「干活」。

为什么需要全新架构?

这要从 Agent 的工作方式说起。过去的 AI 像是一个极其聪明的图书馆管理员——我们问一个问题,它慢条斯理地翻书、整理答案。我们对这种速度是宽容的,因为我们自己打字看书也慢。

但 Agent 完全不同。它不仅要用大模型思考,还要疯狂地调用工具——打开浏览器、控制云端虚拟 PC、在无数个数据库里来回比对。更要命的是,AI 对工具的容忍度极低,要求一切操作都在毫秒级完成。

「它会狠狠地捶打内存。」黄仁勋在台上这样形容。

七芯片 + 五机架

Vera Rubin 架构包含 七款芯片(Vera CPU、Rubin GPU、NVLink 6 交换机、ConnectX-9 网卡、BlueField-4 DPU、Spectrum-6 以太网交换机,以及全新集成的 Groq 3 LPU)和 五套机架系统。

Vera CPU 是世界上首款专为 Agent AI 打造的处理器——效率是传统机架式 CPU 的 2 倍,速度提升 50%,采用 LPDDR5X 内存。黄仁勋毫不掩饰他的骄傲:「我们从没想过会单独卖 CPU,但现在,这绝对是一个价值数十亿美元的业务。」

Rubin GPU 单片直接塞进 288 GB 海量内存——专门用来装载那些越来越庞大的超大语言模型和处理成百上千万的上下文 KV 缓存。

NVLink 带宽也翻了一倍——260 TB/s 的全互联带宽。配合全新的 Kyber 机架,在一个 NVLink 域内直接打通 144 张 GPU,完全抛弃了传统以太网和 InfiniBand 的限制。

Groq 收购与解耦推理:性能飙涨 35 倍

在算力世界里,吞吐量(同时处理巨量任务)和延迟(单次极速响应)是一对物理学上的死敌。英伟达是吞吐量的绝对霸主,但在极致低延迟的 Token 生成上,传统 GPU 架构显得过于笨重。

于是 Groq LPU(语言处理单元)出场了。英伟达用一款名为 Dynamo 的软件,首创了「解耦推理」(Disaggregated Inference):

- 前半段 Prefill(预填充)和 Attention(注意力机制)→ 交给 Vera Rubin 性能王者处理

- 后半段 Decode(解码/Token 生成)→ 卸载给 Groq LPU 降低延迟

结果:在最具商业价值的高端推理层级,性能直接飙涨 35 倍,每兆瓦吞吐量同样提升 35 倍。

这意味着什么?同一座数据中心,换上新架构后能产出 35 倍的 Token——对运营者来说,这就是 35 倍的收入。

OpenClaw 堪比 Linux:每位 CEO 的必答题

黄仁勋在演讲中抛出了一个让全场屏息的判断:

OpenClaw,将堪比这个时代的 Linux,是这个时代的 HTML。

OpenClaw 上线仅数周,下载量和影响力已经超过了 Linux 三十年的积累。它本质上是一套智能体操作系统——能调用大模型、管理文件、拆解任务、协调子智能体,还能发邮件、发短信,以任何模态与人沟通。

在黄仁勋看来,每一家 SaaS 公司迟早都会变成 AgaaS 公司(Agent-as-a-Service),而每位 CEO 现在都必须回答同一个问题:你的 OpenClaw 战略是什么?

为此,英伟达联合 OpenClaw 团队推出 NeMoClaw 参考架构,内置安全防护和隐私路由能力,让企业在私有环境中安全运行智能体系统。

DLSS 5:用 AI 重新发明计算机图形学

黄仁勋回顾了一段很少被提及的历史:GeForce 游戏显卡其实是英伟达有史以来最伟大的「营销活动」。正是全球游戏玩家 25 年的「众筹」,支撑了英伟达研发 CUDA 的漫长冬天——连续 13 代架构,20 年死磕,最终把 CUDA 变成了装机量过亿的庞然大物。

现在,AI 该反哺「老家」了。DLSS 5 把传统 3D 渲染(结构化、100% 可控)和生成式 AI(概率性、极其逼真)揉在了一起:用可控的 3D 数据打底,用生成式 AI 脑补渲染细节。画面既不会出现 AI 幻觉错位,又拥有近乎现实的惊人质感。

万亿美元与太空数据中心

黄仁勋预测,到 2027 年底,Blackwell 和 Rubin 芯片将至少创造 1 万亿美元收入。

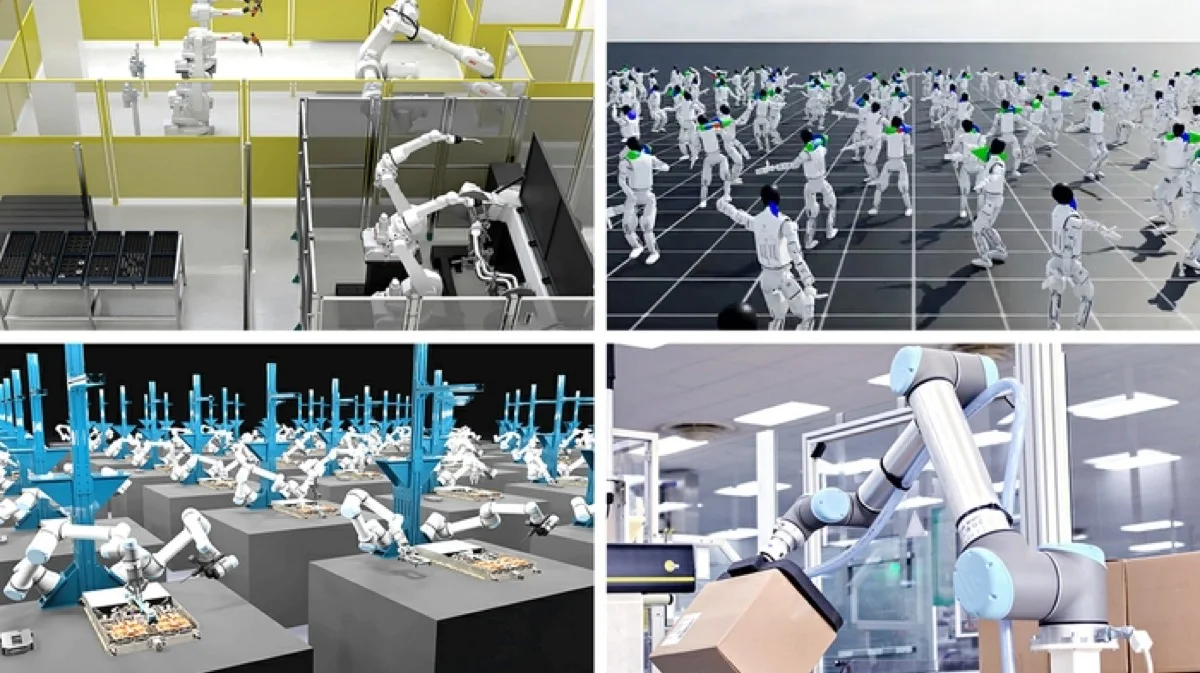

支撑这个数字的逻辑:过去数据中心存放文件,现在它生产 Token。算力就是收入本身。英伟达还发布了 DSX 平台(基于 Omniverse 数字孪生),让工程师在动工前先虚拟仿真整座 AI 工厂。配合 Max-Q 技术,同一套硬件经过算法优化后,Token 生成速度从 700/秒跃升至近 5000/秒,提升 7 倍。

更疯狂的是,英伟达已经把目光投向太空——NVIDIA Space-1 Vera Rubin 计算机正在研发中,目标是在太空中建设数据中心。

自动驾驶的 ChatGPT 时刻

黄仁勋宣布:自动驾驶的 ChatGPT 时刻已经到来。

RoboTaxi Ready 平台新增四位重量级伙伴:比亚迪、吉利、五十铃、日产——这四家每年合计生产约 1800 万辆汽车。加上此前的梅赛德斯、丰田和通用,英伟达的自动驾驶版图已覆盖全球最重要的整车制造商。

英伟达还与 Uber 签署合作,将 RoboTaxi 车辆直接接入 Uber 全球出行网络。

演讲尾声,迪士尼的雪宝机器人登上舞台,和黄仁勋对话。它的大脑是 Jetson 计算机,动作在 Omniverse 中训练,运行于英伟达、迪士尼和 Google DeepMind 联合研发的 Newton 物理引擎之上。黄仁勋说:未来迪士尼乐园所有角色都将拥有真正的智能。

编辑点评

GTC 2026 的信息密度堪称恐怖。但剥开所有的产品发布和技术参数,黄仁勋传递的核心信息只有两个字:垄断。

从最底层的芯片到最上层的应用框架,从游戏显卡到太空数据中心,从自动驾驶到迪士尼机器人——英伟达已经不满足于「卖铲子」,它在重新定义「铲子」的含义。当你的芯片、你的互联协议、你的推理框架、你的开源模型、你的仿真平台同时锁住了整个产业链的每一个环节时,你就不只是一个供应商,你就是这个时代的基础设施本身。

35 倍性能飞跃、万亿美元收入预期、太空数据中心——这些数字听起来像科幻。但 20 年前 CUDA 也像科幻,10 年前深度学习也像科幻。黄仁勋最擅长的事情,就是把科幻变成现实。

这场关于未来 AI 的赌局,英伟达不仅既做庄家又做玩家,它甚至要把牌桌都买下来了。

参考来源: 极客公园